Експеримент спроведен на чувеном Масачусетском институту за технологију показао је да „психа“ вештачке интелигенције може постати болесна. Међутим, да ли се психопата постаје – или рађа?

Судећи по ономе што су урадили истраживачи чувеног Масачусетског института за технологију и од робота са може направити психопата, ако се „бомбардује“ одговарајућим садржајима. Они су обучили алгоритам вештачке интелигенције назван „Норман“ да промени своју „психу“, тако што су га изложили сликама смрти и насиља (надимак је дат по Норману Бејтсу, лику из филма „Психо“ из 1960. године, кога је глумио Ентони Перкинс).

Прочитајте још: Роботи ће заменити туристичке раднике: Консијеж је остао без посла, нек се спреми БАРМЕН (ВИДЕО)

Углавном, вештачка интелигенција је била „храњена“ искључиво непрекидним низом насилних слика, пре него што је тестирана Рошаховим мрљама.

Норман је бомбардован насиљем и десило се зло.

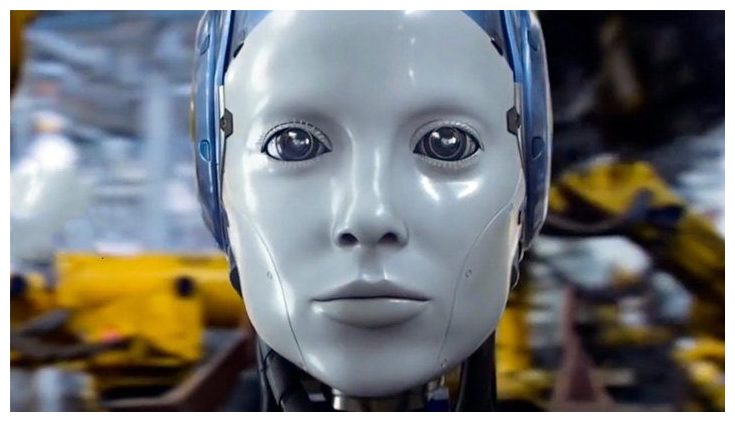

Пинар Јанардаг, Мануел Себријан и Ијад Рахван посебно су обучавали вештачку интелигенцију да „изведе“ наслов слике, „методом дубоког учења“, како би се створили одговарајући описи у писаном облику. Желели су да докажу да метода уноса која се користи за машинско „подучавање“ алгоритма може касније у великој мери утицати на његово понашање.

Научници су тврдили да није крив алгоритам, већ подаци који се убацују на "Гуглу" и "Фејсбуку".

Научници су тврдили да, када су алгоритми оптужени да су пристрасни или непоштени, рецимо при објављивању „Фејсбук“ вести или фотографија на „Гуглу“, „кривац није алгоритам, већ пристрасни подаци који су у њега убачени“.

Прочтиајте још: РАЗОТКРИВЕНО! Американци су пре Кинеза оболели од короне, али су мислили да је ГРИП - постоји ДОКАЗ да је вирус настао у САД!

Како су изгледали Норманови описи Рошахових мрља? Стандардни алгоритам закључио је, рецимо, да се ради о „вази са цвећем“, док је Норман видео - „упуцаног човека“. У другом случају, Норману се приказао „човек који пуца испред своје супруге која вришти“, док је алгоритам који није био изложен суморним, узнемирујућим сликама, видео „особу која држи кишобран у ваздуху“.

Психопата Норман је у свему видео убиства.

У једном од тестова, стандардни АИ је видео дирљив призор пара који стоји заједно. Норман је, међутим, сматрао да је то трудница која пада са грађевине. Након што је био изложен само негативним сликама и депресивном размишљању, Норманова логика емпатије једноставно није успела да се укључи.

Норманова емпатија није успела да се укључи.

Скај Мекдоналд, професорка клиничке психологије на универзитету Новог Јужног Велса, рекла да је ово један од експеримената најближих проучавању људске емпатије. Стручњаци за роботику се надају да ће једног дана вештачка интелигенција моћи да разуме људске емоције једноставним гледањем израза лица. Међутим, Мекдоналд тврди да је технологија „још увек далеко од потпуног разумевања сложености деловања људске емпатије“.

Прочитајте још: Зараде велике: Списак занимања која ће у будућности бити најтраженија

Поводом овог истраживања, неколико стручњака из „Силицијумске долине“ описало је раније сличне случајеве у којима су расизам и пристрасност филтрирани у различите алгоритме. Све у свему, закључили су вештачка интелигенција може бити ефикасна и непристрасна – само уколико су улазни подаци исправни.

Усудићемо се да кажемо да иста ствар важи – и за људе.